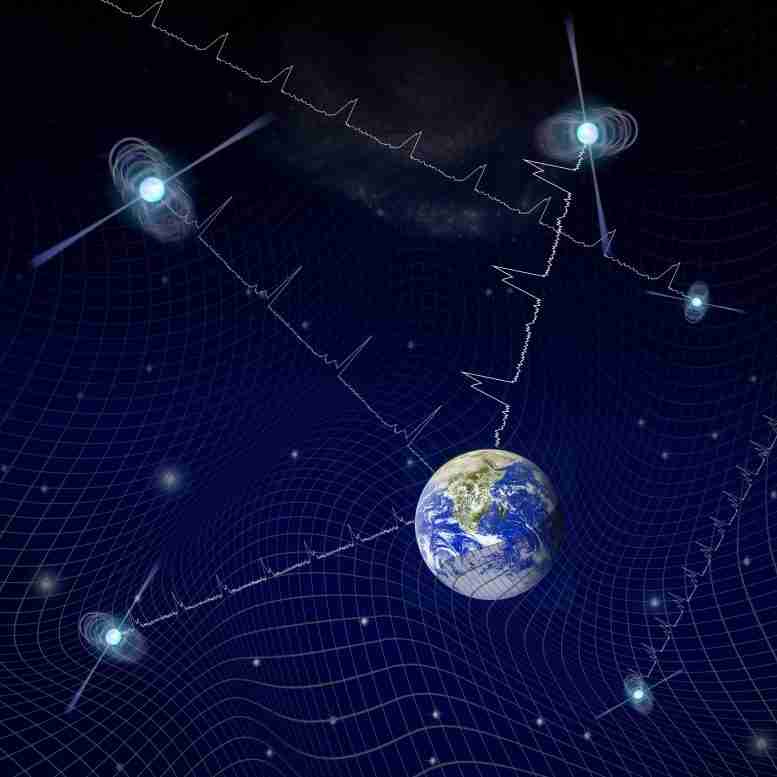

AI由并行卷积光的处理器提升

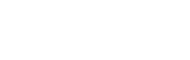

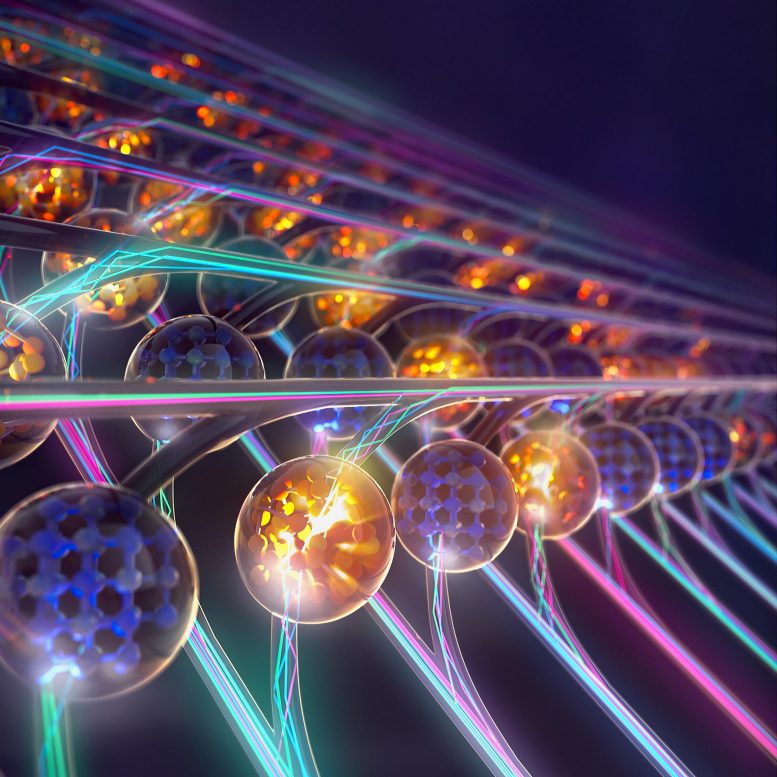

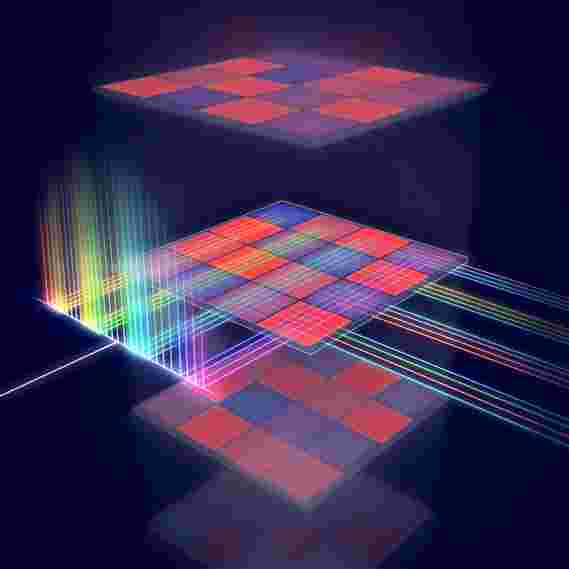

用于在光上运行的矩阵乘法的处理器的示意图。

我们数字时代数据流量的指数增长在处理能力上提出了一些真正的挑战。随着机器学习和AI的出现,例如,自动驾驶车辆和语音识别,向上趋势设置为继续。所有这一切都在沉重的负担对当前计算机处理器跟上需求的能力。

现在,一个国际科学家团队已经转向光线来解决这个问题。研究人员通过使用基于光或“光子”处理器,将处理和数据存储在单个芯片上结合到单个芯片上的新方法和架构,该处理器被示出通过处理信息更快并且并行地超越传统的电子芯片。

科学家们开发了一种用于所谓的矩阵矢量乘法的硬件加速器,这是神经网络的骨干(模拟人脑的算法),本身都用于机器学习算法。由于不同的光波长(颜色)不会相互干扰,因此研究人员可以使用多个波长的光线来平行计算。但是要做到这一点,他们使用了另一种创新技术,在EPFL,基于芯片的“频率梳”的EPFL,作为光源。

用于在光上运行的矩阵乘法的处理器的示意图。

“我们的研究是第一个在人工神经网络领域应用频率梳理,”EPFL在一项研究的领先地位。Kippenberg教授的研究开创了煤炭煤炭的发展。“频率梳提供各种光学波长,其在相同的光子芯片中独立地处理。”

“用于加速机器学习领域的基于轻型处理器,使得能够以高速和吞吐量进行复杂的数学任务,”Münster大学的高级协作Wolfram Pernice表示,在Münster大学,其中一位领导的研究。“这比传统的筹码更快,依赖于电子数据传输,例如TPU(张量处理单元)等图形卡或专用硬件。”

在设计和制造光子芯片之后,研究人员在识别手写号码的神经网络上进行了测试。灵感来自生物学,这些网络是机器学习领域的概念,主要用于图像或音频数据的处理。“输入数据和一个或多个过滤器之间的卷积操作 - 例如,可以识别图像中的边缘,例如,非常适合我们的矩阵架构,”Johannes Feldmann说,现在位于牛津大学材料部门。Nathan Youngblood(牛津大学)补充说:“利用波长多路复用允许更高的数据速率和计算密度,即每个区域的操作,先前未达到。”

“这项工作是欧洲协作研究的真实展示,”埃克塞特大学的大卫怀特说,他领导了欧盟项目乐趣,资助了这项工作。“虽然所涉及的每个研究小组以自己的方式为世界领先,但它正在将所有这些零件带到一起,这使得这项工作成为可能。”

本研究发表于本周的自然,具有深远的应用:人工智能数据的数据更高(和节能)处理,较大的神经网络,用于更准确的预测和更精确的数据分析,大量的临床诊断数据,增强自动驾驶车辆中的传感器数据的快速评估,并通过更多存储空间,计算电源和应用软件扩展云计算基础架构。

参考:由J.费尔德曼,N.布拉德,M.卡尔波夫,H. Gehring集团,X.李,M. Stappers,M.勒加洛,X.赋,A. Lukashchuk,AS“使用集成光子张量核并行处理卷积” Raja,J. Liu,CD Wright,A. Sebastian,TJ Kippenberg,WHP Pernice和H.Bhaskaran,2011年1月6日,Nature.Doi:

10.1038 / S41586-020-03070-1

-

衡量保护的真正成本,以实现更绿色的未来

2022-05-27 -

从地球的微生物瘤中揭开新型基因组 - 将已知的细菌和古代的已知多样性扩展为44%

2022-05-26 -

人工智能神经网络了解何时不值得信任

2022-05-24 -

人畜共患病项目:最大的一组哺乳动物基因组揭示了处于灭绝风险的物种

2022-05-23 -

研究人员创建了首张蜜蜂物种全球地图

2022-05-21 -

到银河系的反中心及以后:盖亚(Gaia)提供的超过18亿颗恒星的详细数据

2022-05-21 -

最敏感的光学接收器,用于基于激光束的空间通信

2022-05-14 -

超越二元:多状态数据存储离开二进制后面

2022-05-13 -

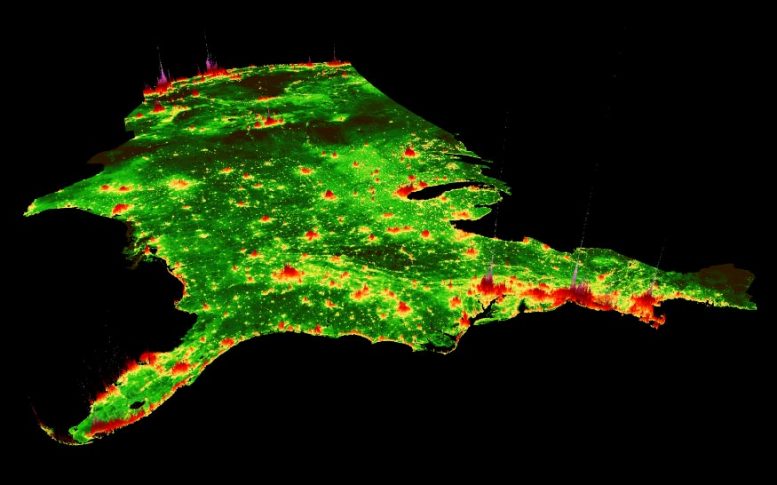

全球污染估计揭示了惊喜,以及机会

2022-05-11 -

脑启发的电子系统可以使人工智能1000倍更节能

2022-05-10 -

Openet:用NASA数据转变美国西部的水管理

2022-05-07 -

破裂地球的泡沫:人工智能有助于在太空中找到磁力爆发

2022-05-05 -

SubnaNoOSecond光学切换可以实现高性能全光数据中心网络

2022-05-05 -

大型强子撞机美女首先发现“开放式魅力”Tetraquark

2022-05-03